1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18

19

20

21

22

23

24

25

26

27

28

29

30

31

32

33

34

35

36

37

38

39

40

41

42

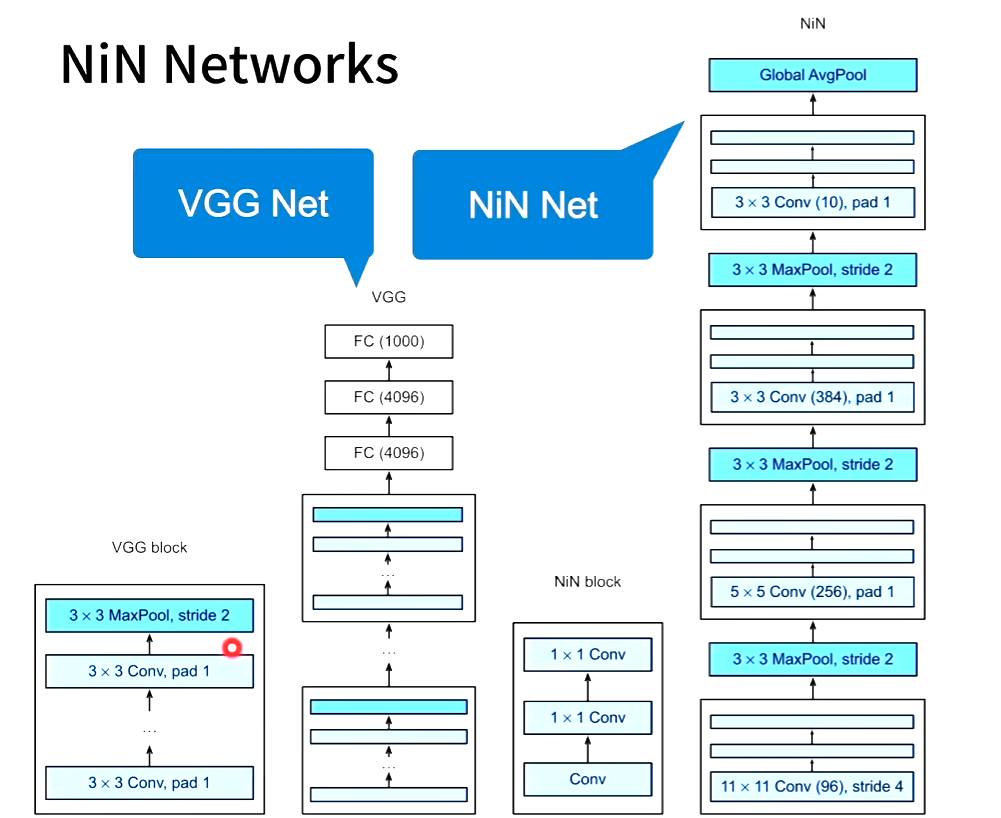

| import torch

from torch import nn

from d2l import torch as d2l

def nin_block(in_channels, out_channels, kernel_size, stride=1, padding=0):

return nn.Sequential(

nn.Conv2d(in_channels, out_channels, kernel_size, stride, padding),

nn.ReLU(),

nn.Conv2d(out_channels, out_channels, kernel_size=1), # 1x1卷积

nn.ReLU(),

nn.Conv2d(out_channels, out_channels, kernel_size=1), # 1x1卷积

nn.ReLU()

)

def nin(num_classes=10):

return nn.Sequential(

nin_block(1, 96, kernel_size=11, stride=4, padding=0), # 卷积层1

nn.MaxPool2d(kernel_size=3, stride=2), # 池化层1

nin_block(96, 256, kernel_size=5, stride=1, padding=2), # 卷积层2

nn.MaxPool2d(kernel_size=3, stride=2), # 池化层2

nin_block(256, 384, kernel_size=3, stride=1, padding=1), # 卷积层3

nn.MaxPool2d(kernel_size=3, stride=2), # 池化层3

nn.Dropout(0.5), # 丢弃层

nin_block(384, 10, kernel_size=3, stride=1, padding=1), # 卷积层4, 输出层

nn.AdaptiveAvgPool2d((1, 1)), # 自适应平均池化

nn.Flatten() # 展平层

)

if __name__ == "__main__":

net = nin()

# 测试网络结构

# X = torch.randn(1, 1, 224, 224) # 输入图像的形状

# for layer in net:

# X = layer(X) # 前向传播

# print(layer.__class__.__name__, 'output shape:\t', X.shape)

lr, num_epochs = 0.01, 10

batch_size = 128

train_iter, test_iter = d2l.load_data_fashion_mnist(batch_size, resize=224)

d2l.train_ch6(net, train_iter, test_iter, num_epochs, lr, d2l.try_gpu())

|